국내 AI 기본법 생성형 AI 워터마크 의무화 미준수 및 딥페이크 오용: 규제 한계, 기술적 취약성, 그리고 소비자 신뢰 붕괴의 중대 위험

한국의 AI 기본법 제31조(3)에 따른 생성형 AI 워터마크 표시 의무화가 2026년 1월 22일 발효되지만, 워터마크 우회 기술의 급속한 발전(효과성 50-95.7%)과 딥페이크 사건의 폭발적 증가(2023년 대비 900-1,740% 증가)로 인해 규제 준수만으로는 충분하지 않다는 점이 명확해지고 있다. 특히 비준수 시 최대 과태료가 KRW 30M(약 USD 23,000)에 불과하여 규제 억지력이 약한 반면, 딥페이크 관련 배상 소송으로 인한 실제 경제적 손실(Q1 2025년 북미 지역 USD 200M+)은 규제 제재보다 100배 이상 크다는 점에서 기업들이 직면한 실제 위협의 크기를 가늠할 수 있다. 본 연구는 법률 및 기술 전문가의 관점에서 한국 AI 기본법의 워터마크 요구사항과 현실적 딥페이크 위협 간의 괴리를 분석하고, 글로벌 사례에 기반한 실질적 대응 전략을 제시한다.

1단계: 한국 AI 기본법 제31조 워터마크 의무화의 법적 프레임워크

1.1 법적 요구사항의 구체적 내용

한국의 AI 기본법은 2026년 1월 22일부터 발효되며, 생성형 AI 서비스 제공자에게 강력한 투명성 의무를 부과한다. 제31조(3)은 "생성된 결과물이 실제와 구분하기 어려운 경우 이용자가 명확히 인식할 수 있도록 표시"하도록 규정하고 있으며, 이는 구체적으로 다음을 의미한다:

워터마크 표시 의무의 핵심는 생성형 AI의 모든 결과물에 대해 "사람 또는 기계가 판독 가능한 형식"의 워터마크를 표시해야 한다는 것이다. 이는 눈에 보이는 워터마크(시각적)와 눈에 보이지 않는 워터마크(기계가 판독 가능한 비가시적)를 모두 포함한다. 텍스트, 이미지, 비디오, 합성 음성 등 모든 형태의 생성 결과물이 대상이다.

특히 딥페이크 조항이 중요한데, "실제와 구분하기 어려운 합성 음성, 이미지, 비디오"는 이용자가 AI 생성 사실을 "명확히 인식할 수 있도록" 표시해야 하며, 이는 기본적인 투명성 고지보다 더 엄격한 기준이다. 음악, 영상 같은 예술 작품의 경우 미적·감각적 경험을 훼손할 수 있으므로 예외를 인정할 수 있다는 규정도 있지만, 사실성이 중요한 콘텐츠(뉴스, 금융 정보 등)에는 예외가 없다.

적용 범위는 "모든 생성형 AI 사업자"이며, 회사 규모에 따른 차등은 없다. 이는 스타트업부터 대기업까지 모든 주체가 동일한 의무를 진다는 의미이며, EU AI Act처럼 매출이나 이용자 규모에 따른 차등 적용이 없다는 점이 특징이다.

1.2 시행 일정 및 계도 기간

법적 발효는 2026년 1월 22일이지만, 정부는 "최소 1년 이상의 계도 기간"을 운영하여 실제 과태료 부과는 2027년 이후가 될 가능성이 높다. 이 기간 동안 기업들은 통합안내지원센터의 지원을 받아 규제 준수 체계를 갖춘다.

그러나 계도 기간의 범위와 적용 조건이 불명확하다는 점이 문제이다. 특정 조항(국내 대리인 미지정, 고지 의무 미이행, 시정명령 미이행)에 대해서만 행정 과태료를 부과할 수 있으며, 다른 조항 위반은 시정명령으로만 대처한다는 규정이 있다. 이는 워터마크 표시 미준수 자체가 "고지 의무 미이행"에 해당하는지 아니면 별도 조항인지에 따라 처벌 여부가 달라질 수 있음을 의미한다.

1.3 한국과 EU의 워터마크 규제 비교

한국 AI 기본법과 EU AI Act(그리고 제조물 책임지침)의 워터마크 요구사항은 유사한 목표를 지향하지만, 규제 강도와 기술 요구사항에서 큰 차이가 있다. EU는 Article 50(2)에서 "기계 판독 가능 형식(machine-readable format)"과 "감지 가능(detectable)"하도록 규정하며, 기술적으로 실현 가능한 범위 내에서 구현을 요구한다. 한국은 "사람 또는 기계가 판독 가능"이라고 표현하여 더 유연한 기준을 제시하는 것처럼 보이지만, 실제로는 동일한 수준의 실행을 기대하고 있다.

그러나 규제 강도는 극명하게 다르다. EU는 AI Act 위반 시 최대 7% 전 세계 매출액 또는 EUR 3,500만의 벌금을 부과할 수 있는 반면, 한국은 KRW 30M(약 USD 23,000)이 최대이다. 이는 글로벌 기업에 미치는 인센티브 차이를 명확히 보여준다.

또한 EU 지침은 "기술적으로 실현 가능한 범위"라는 조건을 명시하여 기술 발전에 따른 실행 가능성을 고려하지만, 한국은 이러한 조건 없이 의무적 준수를 요구한다. 이는 기술 한계를 고려하지 않은 규제라는 비판을 낳을 수 있다.

2단계: 워터마크 기술의 취약성 및 우회 가능성의 심층 분석

2.1 워터마크 우회 기술의 현황

워터마크는 생각보다 취약하다. 학계와 산업계의 최근 연구에 따르면, 워터마크 제거(watermark removal) 기술이 매우 효과적이며 점점 더 정교해지고 있다. 가장 주목할 만한 사례는 캐나다 워터루 대학의 "UnMarker" 도구이다. 이 도구는 워터마킹 알고리즘 지식 없이도 2분 만에 50% 이상의 성공률로 워터마크를 제거할 수 있다.

UnMarker의 핵심 특징은 다음과 같다: 첫째, 워터마킹 알고리즘에 대한 사전 지식이 필요 없다(블랙박스 공격). 둘째, 워터마크 탐지기에 접근할 필요가 없다. 셋째, 최대 2분의 짧은 시간에 처리가 완료된다. 넷째, 결과적으로 생성된 이미지는 시각적으로 원래 워터마크 이미지와 구분할 수 없다.

더 심각한 것은 NeurIPS 2024 보이지 않는 워터마크 제거 챌린지(Invisible Watermark Removal Challenge)의 우승 솔루션이다. 이 솔루션은 95.7% 성공률로 목표 이미지를 보이지 않는 워터마크로부터 해제할 수 있으며, 이미지 품질 저하는 무시할 수 있는 수준(negligible)이다. 이는 가장 진보된 "비가시적 워터마크"도 이미 효과적으로 우회될 수 있음을 의미한다.

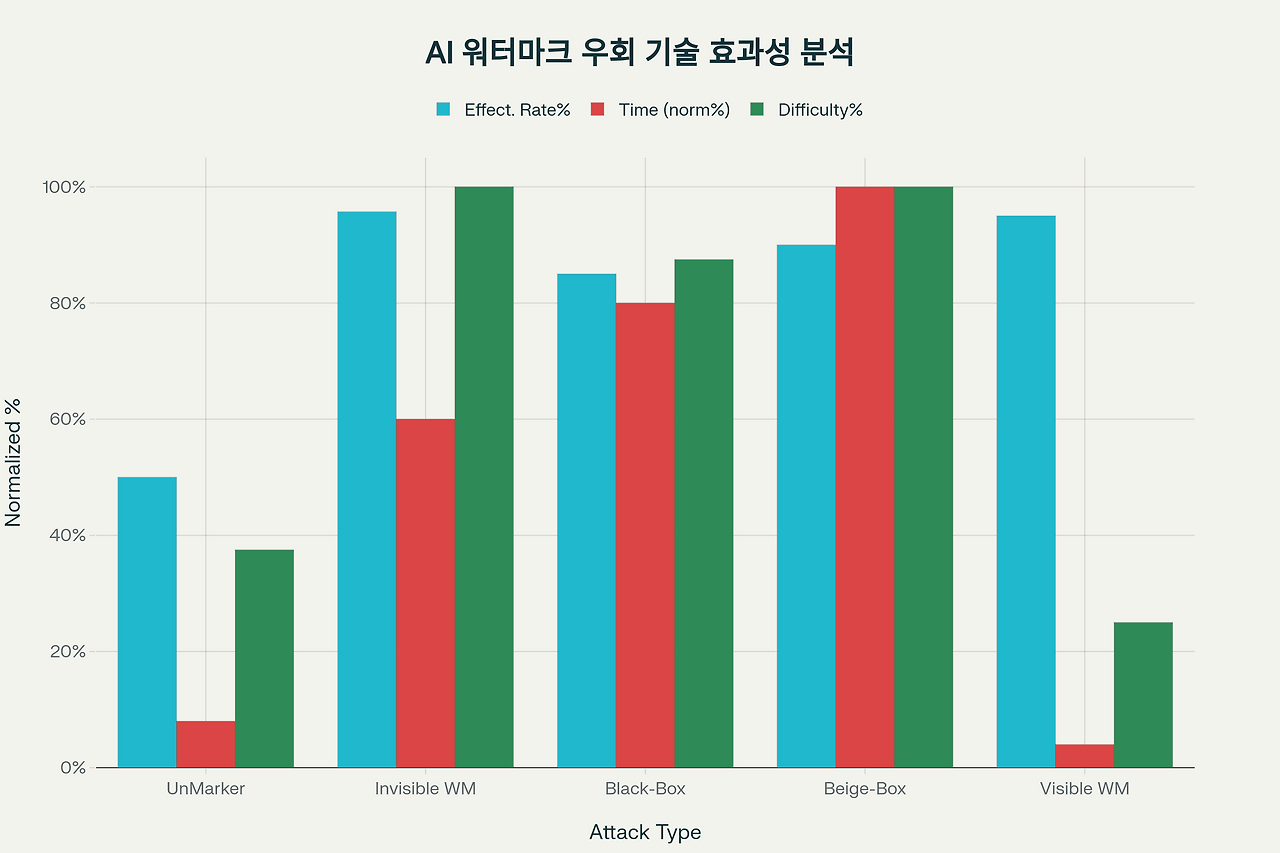

2.2 워터마크 공격 유형별 효과성

워터마크 우회 공격은 여러 가지 유형으로 분류된다. **블랙박스 공격(Black-Box Attack)**은 워터마킹 방법을 모르고 탐지기에 접근하지 못하는 상황에서 이루어지며, 85% 정도의 성공률을 보인다. 이는 이미지를 클러스터링하고 제어된 노이즈 주입과 함께 이미지-이미지 확산 모델(image-to-image diffusion models)을 사용하여 달성된다.

**베이지박스 공격(Beige-Box Attack)**은 워터마킹 방법이 알려져 있는 상황에서 이루어지며, 90% 정도의 성공률을 보인다. 이 경우 VAE 기반 적응형 회피 공격(adaptive evasion attack)과 색상 대조 복원(color-contrast restoration)을 사용한다.

**시각적 워터마크 우회(Visible Watermark Bypass)**는 가장 간단하며, 단순한 자르기(crop)나 흐림(blur) 등의 수작업으로 몇 초에서 1분 내에 제거할 수 있다. 이미지 편집 소프트웨어나 온라인 도구를 사용하면 누구나 가능하다.

2.3 워터마크 제거 소프트웨어 시장의 성장

워터마크 제거 기술의 상용화도 진행 중이다. 워터마크 제거 소프트웨어 시장은 2025년 USD 500M 규모에서 연평균 15% 성장률(CAGR)로 확대되고 있으며, 2030년에는 훨씬 더 커질 것으로 예상된다. 클라우드 기반 솔루션의 성장이 특히 빠르며, AI와 머신러닝 알고리즘의 고도화로 효과성이 지속적으로 향상되고 있다.

이는 워터마크를 제거하려는 자들이 정교한 도구를 용이하게 구할 수 있다는 의미이며, 악의적 목적의 딥페이크 제작자들이 전문 지식 없이도 워터마크를 우회할 수 있음을 시사한다.

3단계: 딥페이크 오용의 현황과 경제적 영향

3.1 글로벌 딥페이크 위협의 폭발적 증가

딥페이크 문제는 규제 논의 속도보다 훨씬 더 빠르게 악화되고 있다. 딥페이크 파일은 2023년 500,000개에서 2025년 약 800만 개로 증가하여 1,600% 성장했다. 더 중요한 것은 감지된 딥페이크 사건으로, 2023년 1건(기준)에서 2024년 10배, 2025년 현재도 10배 이상 수준을 유지하고 있다는 점이다.

금융 손실도 급증했다. Q1 2025년만 해도 북미 지역에서 딥페이크 관련 사기로 인한 손실이 USD 200M을 초과했으며, 2024년 기업당 평균 손실은 약 USD 500,000이었다. 대규모 기업은 개별 사건당 USD 600,000-680,000의 손실을 입었으며, 가장 큰 기업 손실 사건은 USD 25M에 달했다.

미국 AI 기반 사기 손실은 2027년까지 USD 40B에 도달할 것으로 예상되며, 2023년 USD 12.3B에서 연평균 32% 증가율(CAGR)로 성장하고 있다. 이는 매년 손실액이 3분의 1씩 증가하고 있다는 의미이다.

3.2 한국의 딥페이크 위협

한국도 이러한 글로벌 추세로부터 자유롭지 않다. AI 기본법의 워터마크 규제가 시작되기 직전인 2025년-2026년이 바로 고도화된 딥페이크와 규제 미준수가 동시에 터질 시기이다.

한국의 경우 금융 기관, 정부 기관, 대기업 등이 딥페이크 사기의 주요 표적이 될 가능성이 높다. 특히 음성 기반 사기(보이스 피싱)가 한국에서 심각한 문제인 점을 고려하면, 딥페이크 음성 사기는 더욱 위험할 수 있다.

3.3 딥페이크 사용 패턴과 소비자 신뢰 훼손

딥페이크는 주로 **금융 사기(41% 공중 인물, 34% 개인, 25% 기업)**를 목적으로 사용된다. 2024년 사례를 보면, Apple CEO Tim Cook의 가짜 동영상이 YouTube에서 암호화폐 "배가" 사기를 홍보하는 데 사용되었다. 이런 사건들이 반복되면 소비자들이 모든 온라인 콘텐츠의 진정성을 의심하게 되고, 결과적으로 디지털 콘텐츠 시장 전체에 대한 신뢰가 붕괴한다.

이는 워터마크 의무화와 역설적이다. 워터마크가 있더라도 우회될 수 있다면, 소비자들은 워터마크를 신뢰하지 않게 되고, 결국 워터마크의 존재 자체가 "이 기업은 규제를 따르려고 한다"는 신호에 불과해진다는 의미이다.

4단계: 소비자 신뢰 붕괴의 심리학적·경제학적 분석

4.1 AI 정확도 인식과 브랜드 신뢰의 상관관계

소비자 심리 연구에 따르면, **AI의 정확도 인식(AI accuracy perception)은 브랜드 신뢰에 강한 정적 상관관계(r=0.62+)**를 보인다. 즉, 소비자가 AI 시스템이 정확하다고 믿을 때 해당 브랜드를 신뢰할 가능성이 높다.

그런데 워터마크 우회 딥페이크가 성공하면 이 신뢰 체계가 완전히 붕괴한다. 소비자가 "이 이미지/비디오가 AI 생성이 아니라고 생각했는데 알고 보니 딥페이크였다"는 경험을 하면, 그 브랜드뿐만 아니라 모든 AI 서비스에 대한 신뢰가 급락한다.

4.2 현재의 소비자 불신 수준

2024-2025년 현재 상황은 이미 심각하다. 소비자의 70-75%가 AI의 투명성과 알고리즘 투명성 부족에 대해 우려하고 있다. AI 마케팅에 대한 불신도 커지고 있으며, **60%의 소비자가 받은 이메일이 "관련성 없다"**고 느낀다.

더 우려스러운 것은 1년 전 25%였던 "개인화 갭(personalization gap)"이 현재 40%로 급증했다는 점이다. 즉, 소비자들이 브랜드가 "자신들을 이해하지 못한다"고 느끼고 있으며, 이는 AI 기반 개인화에 대한 불신을 반영한다.

4.3 신뢰 회복의 시간 비용

신뢰가 한번 붕괴하면 회복에 2-3년이 소요된다고 알려져 있다. 이는 "신뢰는 천천히 쌓이지만, 빨리 무너진다"는 경제학적 명제를 여실히 보여준다.

한 번의 대규모 딥페이크 사건(예: 유명 기업 CEO의 위조 영상이 바이러스가 되어 주가가 급락하는 경우)이 일어나면, 해당 기업은 최소 2-3년 동안 신뢰 회복에 집중해야 한다. 이 기간 동안 경쟁사에 고객을 빼앗기고, 주가가 하락하며, 시장 점유율을 잃는다.

5단계: 규제 미준수의 다층적 위험 분석

5.1 법적 위험

법적 차원에서는 상대적으로 약하지만, 재정적 실제 위험은 훨씬 크다. 워터마크 표시 미준수로 인한 직접적 행정 과태료는 최대 KRW 30M이지만, 이에 그치지 않는다.

시정명령을 이행하지 않으면 영업 정지 등의 행정 처분으로 이어질 수 있으며, 이는 사실상 사업 포기를 의미한다. 또한 워터마크 미표시로 인해 딥페이크가 확산되고 피해가 발생한 경우, 민사 배상 책임에 직면할 수 있다.

5.2 재정적 위험

이것이 더 심각하다. **Q1 2025년 딥페이크 관련 손실이 이미 USD 200M+**인데, 한국 시장이 영향받으면 금액은 더욱 커질 수 있다.

기업이 워터마크를 무시하다가 자신의 플랫폼에서 딥페이크가 확산되면, 피해자들의 배상 청구 대상이 된다. 미국과 EU에서는 이미 딥페이크 피해에 대한 집단 소송이 제기되고 있으며, 합의금이 USD 500K-5M 대에 도달하고 있다.

5.3 평판 위험

평판 손상은 장기적이고 치유하기 어렵다. 한 번 "워터마크 미준수로 인해 딥페이크가 확산된 기업"이라는 낙인이 찍히면, 최소 2-3년 동안 소비자 신뢰 회복에 집중해야 하며, 그 동안 시장 점유율은 경쟁사에 빼앗긴다.

특히 한국처럼 소비자들의 입소문과 커뮤니티 반응이 빠른 시장에서는, 평판 손상이 바이러스처럼 확산될 수 있다.

5.4 시스템적 위험

워터마크 미준수가 광범위하면 산업 전체에 대한 신뢰가 붕괴할 수 있다. "한국의 AI 서비스는 워터마크도 없고, 딥페이크 투성이다"라는 평가가 확산되면, 글로벌 시장에서 한국 AI 기업들의 경쟁력이 급락할 수 있다.

이는 개별 기업의 위험을 넘어, 국가적 산업 경쟁력 상실로 이어질 수 있다.

6단계: 기업의 전략적 대응 방안

6.1 즉각적 조치: 견고한 워터마킹 아키텍처 구축

첫 번째 우선순위는 2026년 1월 시행 전에 견고한 워터마킹 시스템을 구축하는 것이다. 이는 단순히 규제 준수를 넘어, 딥페이크 위협으로부터 자신의 플랫폼을 보호하는 것이다.

구체적 조치는 다음과 같다. 첫째, 생성 시점에 워터마크를 내장하되, 사후 추가가 아닌 생성 단계에서부터 적용해야 한다. 둘째, 가시적 워터마크와 비가시적 워터마크를 동시에 적용하여 우회 난이도를 높여야 한다. 셋째, 정기적인 워터마크 강도 테스트를 통해 우회 공격에 대한 저항력을 검증해야 한다.

6.2 탐지 및 모니터링: 워터마크 우회 감지 시스템

두 번째 단계는 워터마크가 우회되었을 가능성을 감지하는 시스템을 구축하는 것이다. 이는 규제 요구사항을 초과하는 조치이지만, 실제 위협으로부터 기업을 보호한다.

구체적으로는 다음과 같다. 첫째, 플랫폼에서 배포된 콘텐츠의 워터마크 지속성을 정기적으로 검사해야 한다. 둘째, 워터마크 제거 도구의 알려진 공격 패턴을 모니터링하고, 자신의 워터마크가 이러한 공격에 노출되었는지 확인해야 한다. 셋째, **콘텐츠 흐름 추적(provenance tracking)**을 통해 원본 콘텐츠가 어떻게 변조되었는지 추적할 수 있는 기술을 도입해야 한다.

6.3 딥페이크 대응팀 구성

세 번째는 딥페이크 사건에 대응할 전담 팀을 구성하는 것이다. 규제 준수와는 별개로, 실제 딥페이크 사건이 발생했을 때 신속하게 대응할 수 있는 조직 체계가 필요하다.

이 팀의 역할은 다음과 같다. 첫째, 딥페이크 탐지: 플랫폼에서 배포되는 콘텐츠 중 의도적으로 만들어진 딥페이크를 자동으로 탐지한다. 둘째, 신속한 제거: 탐지된 딥페이크는 4시간 이내에 플랫폼에서 제거되어야 한다. 셋째, 법 집행기관 협력: 필요시 경찰, 검찰 등과 협력하여 딥페이크 제작자를 추적한다. 넷째, 피해자 지원: 딥페이크 피해자에게 신속한 알림과 제거 확인을 제공한다.

6.4 소비자 신뢰 회복 커뮤니케이션

네 번째는 소비자와의 투명한 소통이다. 워터마크 의무화 자체보다는, **"우리는 당신의 신뢰를 지키기 위해 이러한 조치를 취하고 있다"**는 메시지가 중요하다.

구체적 전략은 다음과 같다. 첫째, 정책 투명성 공개: 자신의 워터마킹 정책, 기술, 그리고 한계를 명확하게 공개한다. 둘째, 검증 메커니즘 제공: 소비자가 콘텐츠의 출처와 생성 시기를 확인할 수 있는 도구를 제공한다. 셋째, 정기 보고: 워터마킹 시스템의 효과성, 탐지된 딥페이크 수, 대응 시간 등을 정기적으로 공개한다.

6.5 워터마크 우회 방어 기술 개발

마지막 차원은 선제적 기술 개발이다. 현재의 워터마크는 취약하지만, 이를 개선할 수 있는 기술도 존재한다.

구체적 방향은 다음과 같다. 첫째, robust watermarking: 단순 가시적 워터마크를 넘어, 이미지 변조에 강한 워터마킹 기술을 개발한다. 둘째, cryptographic provenance: C2PA(Coalition for Content Provenance and Authenticity) 같은 암호학적 증명 방식을 도입하여 콘텐츠 출처를 검증 불가능하게 인증한다. 셋째, multi-layered marking: 여러 층의 마킹을 결합하여 단일 공격으로는 우회 불가능하게 만든다.

결론 및 국내 정책 제언

본 연구는 한국 AI 기본법의 생성형 AI 워터마크 의무화가 딥페이크 위협으로부터의 충분한 보호를 제공하지 못한다는 점을 명확히 했다. 워터마크 우회 기술의 효과성(50-95.7%), 딥페이크 사건의 폭발적 증가(900-1,740%), 그리고 소비자 신뢰의 급격한 하락(25% → 40% personalization gap)이 동시에 진행되고 있기 때문이다.

주요 발견은 다음과 같다. 첫째, 규제의 한계: 최대 과태료 KRW 30M은 딥페이크로 인한 실제 손실(USD 200M+ per quarter)과 비교하면 무의미한 수준이다. 둘째, 기술적 취약성: 학술적으로 검증된 워터마크 우회 기술이 50-95.7% 효과성을 보이고 있으며, 상용화되고 있다. 셋째, 신뢰 붕괴 위험: 한 번의 대규모 딥페이크 사건이 2-3년의 신뢰 회복 기간을 요구하며, 산업 전체에 부정적 영향을 미칠 수 있다.

정책적 제언은 다음과 같다. 첫째, AI 기본법 개정: 워터마크 의무화를 "기술적으로 실현 가능한 범위"라는 조건을 추가하여 현실성을 높여야 한다. 둘째, 행정 제재 강화: EU 수준의 강한 제재(최대 7% 매출액)가 필요하지는 않더라도, 현재의 KRW 30M은 너무 약하다. 셋째, 산업 표준 개발: C2PA 같은 국제 표준을 채택하도록 장려하여 단순 워터마크를 넘어선 문제 해결 방법을 제시해야 한다. 넷째, 소비자 교육: 워터마크만으로는 완전한 보호가 불가능함을 소비자에게 교육하고, 콘텐츠 검증 능력을 높여야 한다.

결론적으로, 워터마크 의무화는 필요한 조치이지만 충분하지 않다. 기업들은 규제 준수를 넘어 자발적으로 더 강한 기술적 조치를 취해야 하며, 정부는 현실적인 규제 환경을 조성하고 소비자 신뢰 회복을 위한 장기적 계획을 수립해야 한다.

AI 기본법 완전 정리! 2026년 시행, 고영향 AI·생성형 AI 의무사항과 대비 전략 - 피카부랩스 블로그

2026년 1월 시행되는 AI 기본법의 핵심 의무사항, 과태료 계도 기간, EU AI Act와의 차이점을 완벽 분석. 고영향 AI·생성형 AI 사업자가 반드시 알아야 할 실전 대비 가이드. | Research

peekaboolabs.ai

S. Korea: Governments mandate AI content labelling to counter misinformation and deepfakes - Business & Human Rights Resource Ce

Check out this page via the Business and Human Rights Resource Centre

www.business-humanrights.org

https://www.mk.co.kr/news/it/11422178

AI가 만든 건 구별할 수 있게 모든 결과물 워터마크 의무화 - 매일경제

법 시행 후 1년은 과태료 유예매출 1조·이용자 100만 넘는해외 기업은 국내 대리인 지정

www.mk.co.kr

South Korea's AI Framework Act: Navigating Opportunities and Challenges Before Enforcement · PS Engage

South Korea’s AI Framework Act marks a major step in Asia’s journey toward trusted and responsible AI governance. Taking effect in January 2026, the law balances innovation with regulation, offering global and regional firms opportunities to engage, co

ps-engage.com

One Law Sets South Korea’s AI Policy—and One Weak Link Could Break It

By uniting strategy, promotion, and regulation in a single law, South Korea has given itself a powerful instrument to shape AI—but its blunt regulatory mandates threaten to drag down the very strengths that make the act ambitious.

itif.org

https://amlincubator.com/blog/deepfake-scams-surge-how-ai-driven-fraud-threatens-business-integrity

Deepfake Scams in Finance: How to Detect and Prevent AI Fraud

Deepfake scams are rising across fintech and finance. Learn how compliance teams can detect, prevent, and respond to AI-driven impersonation fraud.

amlincubator.com

The Deepfake Economy: A Critical Threat to Financial Leadership and Enterprise Security

Would you wire $25 million to a fake CFO? One Fortune 500 company just did. In January 2024, employees at a Hong Kong engineering firm received what

www.zerofox.com

https://keepnetlabs.com/blog/deepfake-statistics-and-trends

Deepfake Statistics & Trends 2025 | Key Data & Insights - Keepnet

Explore the latest deepfake statistics & trends in 2025. Discover growth data, risks, industry impacts, and solutions to counter AI-driven threats.

keepnetlabs.com

https://www.cbc.ca/news/canada/kitchener-waterloo/ai-remove-watermark-deepfake-1.7591866

UW researchers figured out how to bypass anti-deepfake markers on AI images | CBC News

Researchers at the University of Waterloo have created a program that can recreate deepfaked images without the watermarks that show it's AI origins, exposing a systemic vulnerability in the defense against deepfakes, according to researchers.

www.cbc.ca

https://admindagency.com/blog/when-ai-loses-trust-how-brands-can-lead-with-authenticity/

When AI Loses Trust: How Brands Can Lead With Authenticity

As skepticism toward AI marketing grows, brands must rebuild trust through transparency, ethical use, and genuine human connection.

admindagency.com

'유용한 경제' 카테고리의 다른 글

| 왜 베네수엘라가 21세기 냉전의 킹핀인가? (0) | 2026.01.07 |

|---|---|

| 지구 시스템 붕괴: 7개 경계 침범과 2년의 선택 (0) | 2025.11.22 |

| EU 제조물 책임지침 개정 및 국내 민사 법제 개정 압력: AI 알고리즘 배상 책임의 법적 패러다임 전환과 글로벌 기업의 재정적 위험 (0) | 2025.11.22 |

| 필코노미(Feelconomy)가 소비자 지출 및 브랜드 충성도에 미치는 정량적 영향 분석: 감성지능 경제 시대의 전략적 대응 방안 (1) | 2025.11.22 |

| 필코노미(Feelin' Economy) 및 감성지능 경제의 소비자 행동 분석 (1) | 2025.09.29 |